1. مقدمه

تعیین موقعیت یک وظیفه مهم در زمینه اطلاعات جغرافیایی است. در مورد دستگاه های تلفن هوشمند، اطلاعات موقعیت یابی به یکی از مهم ترین اطلاعات برای تلفن های هوشمند تبدیل شده است. سنسورهای موقعیت یابی مختلف در تلفن های هوشمند از روش ها و فناوری های مختلف موقعیت یابی استفاده می کنند. در سال های اخیر، فناوری موقعیت یابی در اطراف انواع تجهیزات موقعیت یابی پیشرفت چشمگیری داشته است. با رواج دستگاه های تلفن همراه هوشمند و توسعه فناوری، اطلاعات موقعیت یابی به اطلاعات اساسی برای پردازش و نمایش دستگاه های تلفن همراه هوشمند تبدیل شده است که به طور گسترده در خدمات مبتنی بر مکان، اینترنت اشیا، هوش مصنوعی و ابر هوش آینده استفاده می شود. (ربات + انسان) و غیره سیستم های ماهواره ای ناوبری جهانی (GNSS) مانند Beidou و سیستم موقعیت یابی جهانی (

GPS)، به دلیل پوشش گسترده، دقت موقعیت یابی بالا و عملکرد قوی در زمان واقعی، به طور گسترده در مناطق باز در فضای باز استفاده می شود. با این حال، به دلیل مسدود کردن سیگنال ماهواره توسط ساختمان ها، دقت موقعیت یابی GPS در مرکز شهر و مناطق داخلی به شدت کاهش می یابد. علاوه بر این، ماژول GNSS به طور کلی دارای زمان شروع سرد طولانی است که به شدت بر تجربه کاربر در برنامههای ناوبری غیرخودرو تأثیر میگذارد و محدودیتهای دیگری نیز دارد.

ایستگاه های پایه و شبکه های وای فای (Wi-Fi) نیز روش های رایج موقعیت یابی برای دستگاه های تلفن همراه هوشمند هستند. سیگنال ایستگاه پایه نه تنها منطقه مرکز شهر و تقریباً تمام مناطق داخلی را پوشش می دهد، بلکه پوشش کامل صحنه موقعیت یابی را نیز درک می کند. شبکههای وایفای از مزایای کمهزینه بودن و استقرار راحت برخوردار هستند. آنها به طور گسترده در مکان های سرپوشیده (به عنوان مثال، فرودگاه ها، دانشگاه ها، بیمارستان ها، مناطق تجاری، و ساختمان های مسکونی) توزیع شده اند و یکی از کانون های تحقیقات موقعیت یابی ترمینال های سیار را تشکیل می دهند. ایستگاه پایه و موقعیت یابی Wi-Fi نیازی به استقرار تجهیزات اضافی ندارد. در مقایسه با GNSS، آنها می توانند موقعیت استارت سرد را سریعتر درک کنند و کاربردهای گسترده ای دارند. با این حال، امواج رادیویی در مناطق داخلی یا متراکم ساخته شده معمولاً توسط موانع مسدود می شوند. منعکس شده، شکست یا پراکنده شده و مسیر انتشار آنها به گیرنده تغییر کرده است که منجر به انتشار غیر خط دید می شود. این امر باعث انحرافات زیادی در نتایج موقعیت یابی می شود که به شدت بر دقت موقعیت یابی تأثیر می گذارد.

در سال های اخیر با توسعه سنسورهای ترمینال، تعداد زیادی از سنسورهای موبایل در زمینه موقعیت یابی مورد استفاده قرار گرفته است و تقاضا برای فناوری موقعیت یابی در سناریوهای کاربردی مختلف به میزان قابل توجهی افزایش یافته است. با این حال، روش های متعدد در این مرحله در کاربرد آنها محدود است. از یک طرف، فناوریهای بلوتوث، شناسایی فرکانس رادیویی (RFID)، باند فوقعرض، ZigBee، ژئومغناطیسی، اولتراسونیک و فناوریهای موقعیتیابی مادون قرمز به سرعت توسعه یافتهاند و به طور گسترده در زمینه موقعیتیابی استفاده میشوند. با این حال، روش های موقعیت یابی فوق به تجهیزات اضافی نیاز دارند و موقعیت یابی ژئومغناطیسی نیز توسط محیط عملیاتی در میان عوامل دیگر محدود می شود. از سوی دیگر، روشهای تعیین موقعیت مبتنی بر شتابسنج، ژیروسکوپ و سایر دستگاههای اینرسی، مانند محاسبه مردگان عابر پیاده،

فناوری موقعیت یابی مبتنی بر تصاویر بصری و عمقی از تضعیف سیگنال، تداخل محیطی، انتشار چند مسیری و سایر مشکلات وای فای، بلوتوث و سایر روش های موقعیت یابی شبکه بی سیم رنج نمی برد و نیازی به تجهیزات اضافی یا انواع دیگر ندارد. لوازم جانبی می تواند با هزینه اندکی به دقت موقعیت یابی زیر متر دست یابد. دستگاه های تلفن همراه هوشمند متعدد در بازار می توانند این روش موقعیت یابی را اتخاذ کنند که یکی از جهت گیری های اصلی در زمینه تحقیقات موقعیت یابی برای تحقق موقعیت یابی از طریق تصاویر بصری و عمقی است.

در حال حاضر، دستگاههای تلفن همراه هوشمند معمولاً به دوربینهای تکچشمی مجهز میشوند و موقعیتیابی دید تکچشمی را به روش اصلی برای محلیسازی بصری در دستگاههای تلفن همراه هوشمند تبدیل میکنند. روش های متعددی برای مکان یابی بصری تک چشمی وجود دارد و مستقیم ترین روش بر اساس بازیابی تصویر است. ابتدا باید یک پایگاه داده تصویری با اطلاعات مکان ایجاد کنیم. پس از آن، ما از رنگ تصویر، شکل، بافت، طرح فضایی یا سایر ویژگی ها به عنوان نمایه تصویر جدول استفاده می کنیم. بردار چند بعدی را برای نمایش اطلاعات ویژگی تصویر استخراج کنید. و از فاصله بین ویژگی تصویر پرس و جو و ویژگی تصویر پایگاه داده برای بازیابی مکان تصویر استفاده کنید. دقت این روش به چگالی فضایی پایگاه داده تصویر مربوط می شود. با این حال، چگالی بیش از حد تصویر تأثیر قابل توجهی بر کارایی بازیابی دارد. روش رایج دیگر روش جریان نوری است. مفهوم جریان نوری توسط گیبسون در دهه 1950 ارائه شد.1 ]. برای تخمین سرعت و چرخش از اکتساب تصویر پیوسته استفاده شد. روش جریان نوری مبتنی بر فرض روشنایی غیرقابل تغییر است، که نیاز به دریافت تصویر با نرخ فریم بالا دارد تا اطمینان حاصل شود که فریم های مجاور نیازمندی های محاسبه را برآورده می کنند. این نشان دهنده الزامات بالاتر برای ضبط تصویر و توانایی محاسبه پلت فرم های دستگاه تلفن همراه است. علاوه بر این، روش جریان نوری مبتنی بر دید تک چشمی دارای ابهام مقیاس است. بنابراین، روش جریان نوری بیشتر در اندازهگیری سرعت پیوسته، اجتناب از مانع و سایر صحنهها استفاده میشود و برای تحقق یک تابع محلیسازی بصری کامل بهینه نیست.

در سال های اخیر، مطالعات متعددی در مورد مکان یابی تصویر بر اساس

یادگیری عمیق انجام شده است [ 2]. بیشتر مطالعات مرتبط، یادگیری عمیق را برای ماژولهای فرعی محلی، مانند ماژولهای موقعیتیابی یا ماژولهای تشخیص حلقه بسته، و عدم بکارگیری معماری یادگیری عمیق در کل سیستم، اعمال کردهاند. در مقایسه با روش مکان یابی تصویر یادگیری عمیق فوق، داده های صحنه سه بعدی (3D) متشکل از ابرهای نقطه ویژگی فشرده تر و کارآمدتر هستند. استفاده از داده های صحنه سه بعدی برای مکان یابی بصری برای دستگاه های تلفن همراه هوشمند در مرحله کنونی امکان پذیر است. این روش بر اساس اصل تقاطع دوربین است که شامل موارد زیر است: تعداد زیادی عکس با هم تداخل دارند از قسمت موقعیت یابی جمع آوری می شود، نقاط مشخصه تصویر برجسته از میدان موقعیت یابی استخراج می شود. مختصات شی نقاط مشخصه تصویر برجسته در میدان موقعیت یابی با استفاده از اصل تطبیق چگالی و ساختار از حرکت (SfM) تعیین می شود و کتابخانه ابر نقطه ویژگی ایجاد می شود. در طول موقعیت یابی، نقاط ویژگی تصویر موقعیت یابی محاسبه شده و با ویژگی های تصویر در ابر نقطه ویژگی تصویر مطابقت داده می شود. مختصات جسم شناخته شده نقاط مشخصه منطبق برای تلاقی و تعیین موقعیت دوربین دستگاه تلفن همراه و زاویه دستگاه تلفن همراه هنگام عکسبرداری (از این پس به عنوان “ژست” نامیده می شود) استفاده می شود که می تواند به دقت موقعیت یابی در سطح سانتی متر دست یابد. . نقاط ویژگی تصویر موقعیت یابی محاسبه شده و با ویژگی های تصویر در ابر نقطه ویژگی تصویر مطابقت داده می شود. مختصات جسم شناخته شده نقاط مشخصه منطبق برای تلاقی و تعیین موقعیت دوربین دستگاه تلفن همراه و زاویه دستگاه تلفن همراه هنگام عکسبرداری (از این پس به عنوان “ژست” نامیده می شود) استفاده می شود که می تواند به دقت موقعیت یابی در سطح سانتی متر دست یابد. . نقاط ویژگی تصویر موقعیت یابی محاسبه شده و با ویژگی های تصویر در ابر نقطه ویژگی تصویر مطابقت داده می شود. مختصات جسم شناخته شده نقاط مشخصه منطبق برای تلاقی و تعیین موقعیت دوربین دستگاه تلفن همراه و زاویه دستگاه تلفن همراه هنگام عکسبرداری (از این پس به عنوان “ژست” نامیده می شود) استفاده می شود که می تواند به دقت موقعیت یابی در سطح سانتی متر دست یابد. .

موقعیت یابی فرآیند به دست آوردن مکان دقیق دستگاه های تلفن همراه هوشمند در فضای سه بعدی است. از آنجایی که میخواهیم موقعیت را در فضای سهبعدی بهدست آوریم، نه تنها باید اطلاعات هواپیما را از طریق دوربین تک چشمی به دست آوریم. اطلاعات مقیاس، یعنی بعد سوم کسب اطلاعات نیز بسیار مهم است. دید استریو دوچشمی و تشخیص نور و محدوده (LiDAR) معمولاً برای به دست آوردن اطلاعات فضایی سه بعدی استفاده می شد. با این حال، استحکام دید دوچشمی محدود است و هزینه تجهیزات LiDAR بالا است. علاوه بر این، LiDAR برای استفاده در دستگاه های قابل حمل ساده نیست. بنابراین، دوربین عمق جایگزین خوبی برای دید دوچشمی و LiDAR در جمع آوری اطلاعات سه بعدی است. دوربین عمق می تواند مستقیماً فاصله بین یک جسم و دوربین را ثبت کند. به دلیل قیمت بالای اولیه تجهیزات، کاربران بسیار کمی از دوربین های عمق اولیه وجود داشت و تحقیقات مرتبط نیز پراکنده بود. با این حال، از زمان راه اندازی دوربین های عمق کم قیمت در سال 2011 [3 ]، تعداد کاربران دوربین های عمق کم قیمت به تدریج افزایش یافته است و استفاده از دوربین های عمق به طور فزاینده ای رایج شده است. ترکیب عمق و تصاویر RGB را می توان در تشخیص کنش [ 4 ]، مکان یابی و نقشه برداری همزمان (SLAM) [ 5 ]، بازسازی سه بعدی [ 6 ]، واقعیت افزوده (AR) [ 7 ] و سایر برنامه های اطلاعات جغرافیایی استفاده کرد.

سنسور عمق به طور مستقیم اطلاعات فاصله و مقیاس را به صورت نوری به دست می آورد. در مقایسه با سایر دستگاه ها، سنسور عمق مزایای خاص خود را دارد. روشهای کار دوربینهای عمق عمدتا مبتنی بر استفاده از نور ساختاریافته و زمان پرواز (TOF) بود. آنها دو روش اکتساب داده های عمقی فعال هستند. حسگر عمق Intel RealSense D435i (سازنده: Intel Co., Ltd., Santa Clara, CA, USA) مورد استفاده در این مطالعه بر اساس نور ساختاریافته است. این دوربین به دو دوربین مادون قرمز چپ و راست برای جمع آوری داده های عمق مجهز شده است. گیرنده های مادون قرمز چپ و راست برای دریافت نور مادون قرمز استفاده می شوند. پروژکتورهای ماتریس نقطه مادون قرمز در وسط دستگاه وجود دارد که می تواند نوردهی باند مادون قرمز را افزایش دهد. در یک محیط داخلی، پروژکتورها می توانند به طور قابل توجهی کیفیت تصویر تصویر مادون قرمز را بهبود بخشند و دقت تصویر عمق را بهبود بخشند. سمت راست ترین دوربین RGB برای جمع آوری سیگنال های نور مرئی استفاده می شود. یک حسگر استریو فعال به دلیل عدم همپوشانی مناطق تصویر یا عدم وجود بافت، نویز تولید می کند.8 ]; وجود نویز سیستم نیز باعث ایجاد نویز به شکل حفره هایی در تصاویر عمقی ثبت شده می شود. کیفیت تصاویر با عمق ثبت شده به دلیل حفره ها پایین است. از آنجایی که وجود این حفره ها اثر مرحله کدگذاری ویژگی را تضعیف می کند، باید آنها را در مرحله پیش پردازش پر کنیم. در اینجا، ما از یک الگوریتم مبتنی بر بازسازی مورفولوژیکی [ 9 ] برای پر کردن این حفره ها استفاده کردیم.

در این مقاله از دوربین تک چشمی برای جمع آوری اطلاعات هواپیما و دوربین عمق برای جمع آوری اطلاعات عمق استفاده شده است. اول از همه، ما باید چندین عکس را در صحنه واقعی به عنوان پایه ای برای موقعیت یابی بصری بعدی جمع آوری کنیم، که به عنوان مجموعه آموزشی نیز شناخته می شود. پس از پیش پردازش تصویر عمق مجموعه آموزشی، ژست هر تصویر در مجموعه آموزشی از طریق مراحل ویژگیهای جهتیافته از تست قطعه تسریع شده و استخراج و شرح ویژگیهای عنصری مستقل وابسته به دودویی باینری (ORB) و ثبت تصویر محاسبه میشود. و بهینه سازی نقشه ژست، و مدل سه بعدی صحنه ایجاد می شود. در فرآیند موقعیتیابی بصری، یک تصویر RGB-D توسط یک دستگاه تلفن همراه هوشمند گرفته میشود و موقعیت فعلی دستگاه با بازیابی تصویر تعیین میشود. فناوری بازیابی تصویر بر اساس بینایی کامپیوتری است. این فناوری تشخیص الگو، نظریه ماتریس و سایر رشتهها را ترکیب میکند و مزایای رایانه را در پردازش سریع تعداد زیادی از محاسبات مکرر ارائه میکند. در یک سیستم بازیابی تصویر معمولی، از کاربران خواسته میشود تا یک تصویر حاوی یک شی نمونه یا صحنهای را وارد کنند، پس از آن جستجوی تصاویر با محتوای مشابه یا مشابه در کتابخانه تصویر ساخته شده انجام میشود. این یک فناوری محاسبه شباهت برداری را نشان می دهد که توسعه چندین فناوری را ترکیب می کند و نتایج خودکار، سریع و دقیق را به همراه دارد و از ذهنیت قضاوت انسان جلوگیری می کند. در مرحله بازیابی تصویر، مجموعه آموزشی و مجموعه پرس و جو برای تولید بردار توصیف VLAD خوشه بندی می شوند. برای غلبه بر این مشکل که بردار توضیحات اطلاعات رنگ تصویر را از دست می دهد و دقت بازیابی را در شرایط نوری مختلف بهبود می بخشد، اطلاعات رنگ حریف و اطلاعات عمق را به بردار توضیحات اضافه می کنیم تا عملیات بازیابی انجام شود. در نهایت با استفاده از ابر نقطه مربوط به تصویر نتیجه بازیابی و پوز آن، پوز تصویر بازیابی شده با روش PnP محاسبه می شود. نمودار جریان کل کار نشان داده شده است پوز تصویر بازیابی شده با روش PnP محاسبه می شود. نمودار جریان کل کار نشان داده شده است پوز تصویر بازیابی شده با روش PnP محاسبه می شود. نمودار جریان کل کار نشان داده شده استشکل 1 .

در سال های اخیر، چندین محقق تحقیقات خود را در زمینه موقعیت یابی بصری نیز منتشر کرده اند. وان و همکاران [ 10 ] یک روش اجماع نمونه تصادفی (RANSAC) بهبود یافته برای محلی سازی بصری داخل ساختمان پیشنهاد کرد. آنها تابعی را برای اندازه گیری کیفیت تطبیق جفت تصویر منطبق تعریف کردند. با توجه به کیفیت تطبیق، چهار جفت بهترین تطبیق برای محاسبه ماتریس تبدیل طرح ریزی دو تصویر برای حذف تطابق کاذب انتخاب می شوند. چنگ و همکاران [ 11 ] یک روش مکان یابی بر اساس ساختار سه بعدی پیشنهاد کرد و یک چارچوب فیلتر دو مرحله ای با استفاده از دید و ویژگی های هندسی یک ابر نقطه SfM برای مکان دهی میلیون ها نقطه در مقیاس شهری ارائه کرد. سالاریان و همکاران [ 12] از SfM برای بازسازی موقعیت دوربین سه بعدی استفاده کرد و سرعت همگرایی SfM را با استفاده از معیار بالاترین شباهت درون کلاسی بین تصاویر برگشتی از روش بازیابی بهبود بخشید. سپس، تصویر انتخاب شده و پرس و جو برای بازسازی صحنه سه بعدی استفاده می شود و موقعیت نسبی دوربین توسط SfM تعیین می شود. علاوه بر این، یک الگوریتم تبدیل مختصات دوربین موثر برای تخمین برچسب جغرافیایی پرس و جو معرفی شد. گوان و همکاران [ 13] یک سیستم موقعیت یابی داخلی را پیشنهاد کرد که می تواند به دو مرحله تقسیم شود: آفلاین و آنلاین. در مرحله آفلاین، نقاط مشخصه در قالب ویژگیهای قوی (SURF) و ویژگیهای خط استخراج میشوند تا پایگاه داده تصویر ایجاد شود، در حالی که در فاز آنلاین، ماتریس هموگرافی و ویژگیهای خط برای تخمین موقعیت و جهت استفاده میشوند. این روش هزینه ذخیره سازی پایگاه داده را کاهش می دهد و تاخیر در کاربردهای عملی را کاهش می دهد. کاواموتو و همکاران [ 14] یک الگوریتم تشابه تصویر مبتنی بر رأی را برای بازیابی تصویر پیشنهاد کرد که برای تبدیل هندسی و انسداد تصویر قوی است. برای بهبود عملکرد بازیابی تصویر، رای گیری چندگانه و تست نسبت معرفی شده است. علاوه بر این، یک فیلتر ذرات برای تخمین صاف مسیر حرکت دوربین برای مکان دید معرفی شده است. فنگ و همکاران [ 15 ] یک پایگاه داده نقشه بصری را ایجاد کرد که شامل ویژگی های بصری و ویژگی های مکان مربوطه بود. پس از آن، تصاویر پرس و جوی دو کاربر با دو تصویر پایگاه داده تطبیق داده شد و موقعیت و وضعیت دوربین پرس و جو با استفاده از واحد اندازه گیری اینرسی (IMU) و دستگاه قطب نما الکترونیکی روی گوشی هوشمند به دست آمد.

Çinaroğlu و همکاران. [ 16 ] توصیف کننده معنایی را از طریق تقسیم بندی معنایی به دست آورد و متعاقباً از جستجوی تقریبی نزدیکترین همسایه برای محلی سازی استفاده کرد. موفقیت این روش با روش مبتنی بر توصیفگر محلی که معمولاً در ادبیات استفاده می شود مقایسه می شود. بر این اساس، یک روش ترکیبی که این دو روش را ترکیب میکند، پیشنهاد شد.

کیم و همکاران [ 17 ] یک روش مکان یابی بر اساس داده های تصویر و نقشه پیشنهاد کرد که برای محیط های مختلف مناسب است. برای تحقق فرآیند بومی سازی، آنها از روش محلی سازی مبتنی بر تصویر و روش محلی سازی مونت کارلو با پایگاه داده نقشه پیشینی استفاده کردند. نتایج تجربی نشان می دهد که مجموعه داده باز اثر رضایت بخشی در محیط های مختلف دارد. برای غلبه بر محدودیت های منابع دستگاه های تلفن همراه، Tran et al. [ 18] سیستمی را طراحی کرد که از مقیاس پذیری بازیابی تصویر و دقت موقعیت یابی بر اساس مدل سه بعدی بهره می برد. یک الگوریتم جستجوی آبشاری جدید مبتنی بر هش برای محاسبه سریع رابطه متناظر از دو بعدی به سه بعدی پیشنهاد شد. علاوه بر این، یک الگوریتم چندگانه RANSAC جدید برای دستیابی به تخمین زاویه دقیق پیشنهاد شد. این چالش سازه های ساختمانی مکرر در موقعیت یابی محیط شهری را حل می کند.

فنگ و همکاران [ 19 ] از یک حسگر RGB-D برای ساختن یک نقشه بصری استفاده کرد که حاوی عناصر اساسی موقعیتیابی مبتنی بر تصویر، از جمله وضعیت قرارگیری دوربین، ویژگیهای بصری و ساختار سهبعدی ساختمانها است. با استفاده از ویژگیهای بصری منطبق و مقادیر عمق متناظر، یک الگوریتم بهینهسازی محلی جدید برای تحقق ثبت ابر نقطه و تخمین موقعیت دوربین پایگاه داده پیشنهاد شدهاست. سپس، سازگاری کلی نقشهبرداری با بهینهسازی گراف بهدست آمد. بر اساس یک نقشه بصری، روش محلی سازی مبتنی بر تصویر با استفاده از محدودیت اپی قطبی مورد مطالعه قرار می گیرد. او و همکاران [ 20] یک تخمین موقعیت شش درجه آزادی (6-DOF) برای یک سنسور دید سه بعدی قابل حمل نصب شده بر روی دستگاه های تلفن همراه پیشنهاد کرد. یک مدل سه بعدی دقیق از محیط داخلی و یک مدل قدرت سیگنال دریافتی Wi-Fi در مرحله آموزش آفلاین ایجاد شده است. در فرآیند تعیین موقعیت آنلاین، نویسندگان ابتدا از سیگنال Wi-Fi برای تعیین مکان دستگاه در مدل فرعی سه بعدی استفاده می کنند. سپس، تخمین زاویه 6-DOF با تطبیق ویژگی بین تصویر دو بعدی جمع آوری شده آنلاین و تصویر فریم کلیدی مورد استفاده برای ساخت مدل سه بعدی محاسبه می شود.

علاوه بر این، کار زیادی با استفاده از روش های یادگیری عمیق برای ارزیابی شباهت تصویر به منظور موقعیت یابی وجود دارد. شیا و همکاران یک روش بازیابی تصویر کد هش نظارت شده بر اساس یادگیری بیان تصویر [ 21 ] را پیشنهاد کرد. این روش نیازی به استفاده از ویژگی های بصری تعریف شده مصنوعی در استخراج ویژگی ندارد و در استفاده از شبکه عصبی عمیق برای استخراج ویژگی های تصویر حرف اول را می زند. لای و همکاران یک هش نظارت عمیق برای بازیابی سریع تصویر [ 22 ] پیشنهاد کرد که دادههای ویژگی تصویر و کد هش را با استفاده از برچسب تصویر و سایر اطلاعات کمکی استخراج میکند. به منظور برآورده کردن الزامات عملکرد سیستم بازیابی تصویر در مقیاس بزرگ، لیانگ و همکاران. یک هش عمیق برای یادگیری کدهای باینری فشرده [ 23]، که رابطه غیرخطی بین تصاویر مشابه را از طریق شبکه عصبی عمیق استخراج می کند. لیو و همکاران یک هش نظارت عمیق برای بازیابی سریع تصویر [ 24 ] برای یادگیری رابطه معنایی شباهت بین بیان ویژگی تصویر و کد هش با استفاده از دادههای تصویر برچسبگذاری شده به عنوان اشیا، پیشنهاد کرد.

ساختار این مقاله به شرح زیر است. روش های ساخت مدل سه بعدی، بازیابی تصویر و تخمین وضعیت در بخش 2 ، بخش 3 و بخش 4 ارائه شده است. بخش 5 محیط های آزمایشی و مجموعه داده ها را توصیف می کند و نتایج تجربی را مورد بحث قرار می دهد. نتیجه گیری در بخش 6 ارائه شده است .

2. ساخت مدل سه بعدی

2.1. استخراج و توصیف نقطه ویژگی

در یک صحنه واقعی، تصاویر رنگی و عمقی با هم ثبت می شوند. برای ایجاد ارتباط بین تصاویر مختلف، نقاط مشخصه باید از تصویر استخراج و تجزیه و تحلیل شوند. پس از آن، ثبت تصویر و سایر عملیات ها را می توان برای محاسبه ژست هر تصویر انجام داد، که می تواند به عنوان مبنای موقعیت یابی بصری مورد استفاده قرار گیرد. الگوریتم های متعددی برای استخراج و توصیف نقاط ویژگی وجود دارد. در اینجا، الگوریتم ORB را هم با دقت و هم با کارایی انتخاب کردیم. ORB، که نام کامل آن ویژگیهای جهتدار از تست قطعه شتابدار (FAST) و ویژگیهای عنصری مستقل باینری چرخشی (BRIEF) است، یک الگوریتم استخراج و توصیف سریع ویژگی است که توسط Ethan Rublee و همکارانش پیشنهاد شده است. [ 25 ]. استخراج ویژگی از الگوریتم FAST [ 26]، و شرح ویژگی بر اساس الگوریتم BRIEF [ 27 ] بهبود یافته است. این بر اساس اولیه خود بهبود یافته و بهینه شده است. در مقایسه با سایر روشهای استخراج ویژگی، مانند تبدیل ویژگی تغییرناپذیر مقیاس (SIFT) [ 28 ] و ویژگیهای قوی سریع (SURF) [ 29 ]، سرعت ORB تقریباً 100 برابر SIFT و 10 برابر SURF است.

2.2. ثبت تصویر

قبلا استخراج و تطبیق نقاط ویژگی بین تصاویر را انجام می دادیم و پس از آن می توانستیم تصاویر را ثبت کنیم. فرض کنید دو فریم داریم، [ خطای پردازش ریاضی ]اف1و [ خطای پردازش ریاضی ]اف2.علاوه بر این، ما دو مجموعه از نقاط ویژگی متناظر یک به یک را به دست می آوریم:

جایی که [ خطای پردازش ریاضی ]پو [ خطای پردازش ریاضی ]�نقاطی هستند [ خطای پردازش ریاضی ]آر3.

هدف این مسئله یافتن یک ماتریس چرخش است [ خطای پردازش ریاضی ]آرو بردار جابجایی [ خطای پردازش ریاضی ]تیبه طوری که:

در واقع، به دلیل وجود خطا، امکان برابری سمت چپ و راست وجود ندارد. چرخش [ خطای پردازش ریاضی ]آرو بردارهای جابجایی [ خطای پردازش ریاضی ]تیباید با به حداقل رساندن خطاهای زیر حل شود:

این مشکل با استفاده از روش پرسپکتیو-n-نقطه (PnP) [ 30 ] حل می شود. PnP روشی است که برای حل حرکت از جفت نقطه سه بعدی به دو بعدی استفاده می شود. روش های متعددی برای حل مسائل PnP وجود دارد، مانند پرسپکتیو-3 نقطه ای (P3P) [ 31 ]، PnP کارآمد (EPnP) [ 32 ] و PnP جهانی (UPnP) [ 33 ]. در اینجا از روش P3P برای محاسبه حرکت استفاده کردیم.

2.3. بهینه سازی نمودار ژست

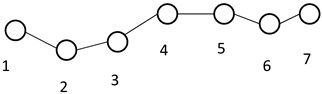

گراف ژست همانطور که از نامش پیداست، نموداری است که از ژست دوربین تشکیل شده است. نمودار در اینجا بر اساس نظریه گراف است. از گره ها و لبه ها تشکیل شده است:

در ساده ترین حالت، گره هر حالت (فرم کواترنیون) دوربین را نشان می دهد:

لبه به تبدیل بین دو گره اشاره دارد:

شکل زیر یک نمودار شماتیک از نقشه پوز در فرآیند ساخت مدل سه بعدی را نشان می دهد:

این به دلیل وجود خطا در لبه است [ خطای پردازش ریاضی ]�من،�، که داده های داده شده توسط تمام یال ها را ناسازگار می کند. در فرآیند بهینه سازی گراف پوز، خطای ناسازگاری باید بهینه شود:

جایی که [ خطای پردازش ریاضی ]ایکسمن*برآورد است [ خطای پردازش ریاضی ]ایکسمن. در فرآیند بهینه سازی یک مقدار اولیه داشتند. سپس با توجه به گرادیان تابع هدف به [ خطای پردازش ریاضی ]ایکس:

ارزش [ خطای پردازش ریاضی ]ایکسبرای کاهش تنظیم شده است [ خطای پردازش ریاضی ]�. اگر این مشکل همگرا شود، تغییر در [ خطای پردازش ریاضی ]ایکسکوچکتر خواهد بود و [ خطای پردازش ریاضی ]�به حداقل خواهد رسید. در طی این تکرار، تغییر در مقدار [ خطای پردازش ریاضی ]ایکساست [ خطای پردازش ریاضی ]ایکس*.

تا اینجا، مسئله را می توان به عنوان یک مسئله بهینه سازی غیرخطی انتزاع کرد. این مشکل تنظیم بسته (BA) [ 34 ] نیز نامیده می شود و روش لونبرگ مارکوارت (LM) [ 35 ] معمولاً برای بهینه سازی تابع خطای مربع غیرخطی استفاده می شود.

3. بازیابی تصویر

3.1. خوشه بندی ویژگی ها

در فرآیند ساخت مدل سه بعدی، نقاط ویژگی از تمامی تصاویر نمونه استخراج می شود. در مرحله بازیابی تصویر، بر اساس این نقاط ویژگی استخراج شده، باید نقاط ویژگی را خوشه بندی کنیم تا کتاب کد به دست آید. سپس، کتاب کد برای نگاشت بردار ویژگی n بعدی اصلی به فضای k بعدی استفاده می شود. نتایج الگوریتم خوشهبندی بر کیفیت کتاب کد تأثیر میگذارد که برای فرآیند بازیابی بعدی بسیار مهم است. خوشه بندی یک الگوریتم یادگیری بدون نظارت است. ماهیت آن این است که به طور خودکار اشیاء مشابه را در یک خوشه بدون هیچ گونه آموزش اضافی طبقه بندی کند. در اینجا ما از الگوریتم K-means برای خوشه بندی ویژگی ها استفاده می کنیم. مهم ترین ویژگی این الگوریتم این است که درک آن آسان و سریع اجرا می شود.

فرآیند الگوریتم خوشه بندی ویژگی به شرح زیر است:

مرحله 1: به صورت تصادفی انتخاب کنید [ خطای پردازش ریاضی ]کنقاط نمونه به عنوان مرکز هر خوشه. [ خطای پردازش ریاضی ]{�1،�2،�3،⋯،�ک}. فاصله بین نقاط مرکزی تا حد امکان تنظیم می شود.

مرحله 2: فاصله بین تمام نقاط نمونه و مرکز را محاسبه کنید [ خطای پردازش ریاضی ]کخوشه ها سپس تمام نقاط بر اساس اصل نزدیکترین همسایه به نزدیکترین مرکز خوشه تقسیم می شوند. فرمول زیر فرآیند تقسیم نقاط نمونه را به مراکز خوشه ای نشان می دهد:

جایی که [ خطای پردازش ریاضی ]ایکسمنهست [ خطای پردازش ریاضی ]مننقطه نمونه، [ خطای پردازش ریاضی ]��هست [ خطای پردازش ریاضی ]�مرکز خوشه، [ خطای پردازش ریاضی ]جمنو مرکز خوشه ای است که به آن اختصاص داده شده است [ خطای پردازش ریاضی ]مننقطه نمونه

مرحله 3: مرکز خوشه هر کلاس را با توجه به اشیاء موجود آنها دوباره محاسبه کنید. فرمول محاسبه در زیر آمده است:

مرحله 4: مراحل 2 تا 3 را تکرار کنید تا موقعیت مرکز خوشه تقریباً بدون تغییر باشد و مرکز خوشه مرکز نقطه ویژگی باشد.

برای اطمینان از همگرایی الگوریتم خوشهبندی ویژگی، یک تابع ضرر باید تعریف شود:

این نشان دهنده مجموع مربع فواصل هر نقطه نمونه تا مرکز خوشه است. نتیجه ایده آل الگوریتم خوشه بندی ویژگی، به حداقل رساندن تابع ضرر است. اگر تابع تلفات فعلی به حداقل مقدار نرسد، ابتدا می توانیم مرکز خوشه را حفظ کنیم [ خطای پردازش ریاضی ]��از هر خوشه نقطه مرکز خوشه [ خطای پردازش ریاضی ]جمنهر نقطه نمونه برای کاهش تابع هدف تنظیم شد. متقابلا، [ خطای پردازش ریاضی ]جمنبدون تغییر باقی می ماند، در حالی که تغییر در [ خطای پردازش ریاضی ]��به همین ترتیب می تواند عملکرد ضرر را کاهش دهد. از آنجایی که فرمول بالا یک تابع غیر محدب است، الگوریتم خوشه بندی ممکن است به حداقل جهانی نرسد، اما در عوض به حداقل محلی همگرا شود. در این حالت، باید چندین بار الگوریتم خوشهبندی ویژگی را اجرا کنیم، هر بار نقطه مرکزی خوشه را بهطور تصادفی انتخاب کنیم و سپس کوچکترین نقطه مرکزی را در نتیجه نهایی انتخاب کنیم.

3.2. کدنویسی ویژگی

پس از به دست آوردن کتاب کد، میتوانیم شروع به رمزگذاری ویژگیها کنیم، که هدف آن کاهش مقدار زیاد نویز تولید شده در حین استخراج ویژگی است. این فرآیند اطلاعات اضافی را حذف می کند و بردار نمایش ویژگی را ساده می کند. کدگذاری ویژگی نه تنها بیانگر وکتور را بهبود میبخشد، تصویر را بهتر بیان میکند، بلکه یک الگوی کنتراست یکپارچه و استاندارد ایجاد میکند، که منجر به ایجاد یک شاخص در بازیابی تصویر بعدی میشود.

این یک پیش نیاز برای فرآیند بازیابی تصویر است که یک تصویر را به عنوان یک بردار نشان دهد. یک روش نمایش برداری تصویر بر اساس ویژگی های بصری محلی استفاده شد. مراحل مشخص به شرح زیر است:

مرحله 1: فایل تصویر را بخوانید. توصیفگر ویژگی محلی تصویر استخراج و ثبت شد [ خطای پردازش ریاضی ]{ایکس1،ایکس2،⋯،ایکسمن،⋯،ایکس�}. برای یک پایگاه داده تصویر با اندازه نمونه n، ابتدا توصیفگرهای ویژگی محلی را از همه تصاویر استخراج می کنیم، با این فرض که تعداد ویژگی های محلی استخراج شده n و هر توصیفگر ویژگی محلی است. [ خطای پردازش ریاضی ]ایکسمن128 ابعاد است. سپس تمام توصیفگرها از a استخراج می شوند [ خطای پردازش ریاضی ]�×128ماتریس ابعادی

مرحله 2: از الگوریتم خوشه بندی ویژگی برای خوشه بندی موارد استخراج شده استفاده کنید [ خطای پردازش ریاضی ]�توصیفگرها برای ایجاد فرهنگ لغت تصویری تعداد مراکز خوشه را به عنوان تنظیم کنید [ خطای پردازش ریاضی ]کو کلمات بصری به عنوان [ خطای پردازش ریاضی ]{�1،�2،⋯،��،⋯،�ک}.

مرحله 3: هر ویژگی محلی را کمی کنید و آن را با استفاده از ساختار داده درخت KD [ 36 ] به نزدیکترین مرکز خوشه تقسیم کنید:

جایی که [ خطای پردازش ریاضی ]نن(ایکسمن)مرکز خوشه ای است که به آن اختصاص داده شده است [ خطای پردازش ریاضی ]ایکسمن.

مرحله 4: باقیمانده مرکز خوشه و ویژگی های محلی را محاسبه کنید، تمام باقیمانده های هر تصویر را در همان مرکز خوشه جمع کنید و سپس آنها را عادی کنید. در نهایت، هر مرکز خوشه یک مجموع باقیمانده به دست می آورد. اگر هر توصیفگر ویژگی محلی 128 بعدی باشد، مجموع باقیمانده ها نیز یک بردار 128 بعدی است. ما بردار را به صورت S تعریف می کنیم . ویژگی های مختلف ممکن است نشانه های متفاوتی از خود نشان دهند.

مرحله 5: باقیمانده ها را جمع کنید. فرمول جمع باقیمانده به صورت زیر بیان می شود:

جایی که [ خطای پردازش ریاضی ]��مجموع باقی مانده از است [ خطای پردازش ریاضی ]�مرکز خوشه

مرحله 6: مجموع [ خطای پردازش ریاضی ]کباقیمانده برای ایجاد یک بردار طولانی [ خطای پردازش ریاضی ][�1،�2،⋯،�ک]با طول [ خطای پردازش ریاضی ]ک×128. پس از نرمال سازی، بردار توصیفگرهای تجمع محلی (VLAD) [ 37 ] به دست می آید.

3.3. ترکیب اطلاعات رنگ و عمق در بردار توصیفگر تجمعی محلی (VLAD)

روش کدگذاری ویژگی ما، الگوریتم مرحله کدگذاری ویژگی بازیابی تصویر در این مطالعه است. هم سریع و هم کارآمد است. با این حال، برخی از اطلاعات مفید در فرآیند توصیف ویژگی از بین می رود، که توانایی تشخیص نقاط ویژگی را ضعیف می کند. این منجر به تطبیق نادرست در روند تطبیق تصویر می شود و بر اثر بازیابی نهایی تأثیر می گذارد.

برای حل مشکل فوق، اطلاعات رنگ تصویر را در مرحله کدگذاری ویژگی اضافه کردیم، به طوری که بردار کدگذاری حاوی اطلاعات رنگ باشد. در مقابل، تجهیزات دریافت تصویر موقعیت یابی بصری ما نه تنها یک دوربین RGB بلکه یک دوربین عمق نیز دارد به طوری که اطلاعات عمق نیز ابزار بسیار مهمی برای بهبود دقت موقعیت یابی است. ما اطلاعات عمق را در مرحله کدگذاری ویژگی اضافه کردیم به طوری که بردار کدگذاری شامل اطلاعات عمق است. در مرحله کدگذاری ویژگی، ویژگی هایی را که قبلا استخراج کرده بودیم جمع آوری کردیم و اهمیت تجمیع در ساده سازی تعداد ویژگی ها است. در تصویر، بعد توصیفگر باینری استخراج شده توسط عملگر ORB 128 است، بنابراین یک [ خطای پردازش ریاضی ]ک×128بردار بعد توصیفگر تجمیع شده محلی (VLAD) تصویر را می توان پس از کدگذاری ویژگی به دست آورد، که به طور قابل توجهی پیچیدگی محاسباتی را در مقایسه با توصیفگر ویژگی ORB بزرگ کاهش می دهد. در این سناریو، ترکیب وکتور VLAD با اطلاعات رنگ استخراج شده از تصویر و اطلاعات عمق استخراج شده از تصویر عمق، هزینه زمانی را به میزان قابل توجهی افزایش نمی دهد و مقدار قابل توجهی از حافظه را اشغال نخواهد کرد. این امر ضمن اطمینان از سرعت تطابق، استفاده از اطلاعات ارزشمند تصویر را افزایش میدهد، استحکام رنگ و عمق را بهبود میبخشد و تمایز هر بردار ویژگی تصویر را تقویت میکند. همچنین میتواند جلوه بازیابی تصویر بهتری را در محیطی با نور و تغییر مقیاس به دست آورد.

در فرآیند بهبود الگوریتم کدگذاری ویژگی VLAD برای بازیابی تصویر، تصویر RGB ورودی ابتدا به یک تصویر خاکستری تبدیل میشود و سپس مقادیر سه کانال موجود در تصویر RGB به فضای رنگی حریف تبدیل میشود تا به دست آید. [ خطای پردازش ریاضی ]�1، [ خطای پردازش ریاضی ]�2، [ خطای پردازش ریاضی ]�3و ماتریس تصویر مربوط به سه کانال رنگی است. فضای رنگی حریف یکی از برجسته ترین توصیفگرهای رنگ اصلی است [ 38 ]. حریف فضای رنگی را به سه کانال تجزیه می کند، یعنی: [ خطای پردازش ریاضی ]�1، [ خطای پردازش ریاضی ]�2، و [ خطای پردازش ریاضی ]�3. هر کانال توسط یک توصیفگر توصیف می شود. روش تبدیل از فضای RGB به فضای حریف در فرمول های زیر بیان می شود:

اینجا، [ خطای پردازش ریاضی ]�1و [ خطای پردازش ریاضی ]�2کانال ها به ترتیب حاوی رنگ های حریف قرمز-سبز و آبی-زرد هستند که تغییر ناپذیری خوبی نسبت به روشنایی تصویر دارند. را [ خطای پردازش ریاضی ]�3کانال حاوی اطلاعات شدت فضای رنگ است که تحت تأثیر ضریب مقیاس قرار می گیرد. کانال های سه رنگ بالا فضای رنگی حریف را تشکیل می دهند. در صحنه های واقعی زندگی روزمره، تغییرات شرایط نور شامل تغییر شرایط روشنایی و شرایط رنگ است. فضای رنگ حریف شامل سه کانال است. کانال های O 1 و O 2 به ترتیب شامل رنگ های قرمز-سبز و زرد-آبی هستند که نسبت به روشنایی تصویر تغییر ناپذیری خوبی دارند. هنگامی که شرایط روشنایی تغییر می کند، قوی هستند. کانال O 3 اطلاعات شدت و مقدار O است 3 استبا تغییر شرایط رنگ، کانال تغییر نخواهد کرد. به طور خلاصه، فضای رنگی حریف می تواند استحکام بازیابی تصویر را در شرایط نوری مختلف افزایش دهد.

افزودن سه کانال اطلاعات رنگ در مرحله کدگذاری ویژگی بازیابی تصویر، نه تنها کارایی توصیفگر باینری ORB را حفظ میکند، بلکه استحکام ساختار بازیابی تصویر را نسبت به رنگ بهبود میبخشد.

در فرآیند کدگذاری VLAD، توصیفگرهای ORB هر تصویر بر اساس اصل نزدیکترین همسایه به تمام مراکز خوشه اختصاص داده می شوند و در هر مرکز خوشه چندین توصیفگر ORB وجود دارد. ما نزدیکترین توصیفگر ویژگی را از هر مرکز خوشه به عنوان نقطه کلیدی رنگ و عمق تصویر می گیریم و اطلاعات رنگ و اطلاعات عمق را با استفاده از کدگذاری باینری استخراج می کنیم. برای هر نقطه کلیدی [ خطای پردازش ریاضی ]من، ناحیه 3 × 3 R با نقطه مشخصه کلیدی به عنوان مرکز از ماتریس تصویر مربوطه انتخاب شده است. [ خطای پردازش ریاضی ]�1، [ خطای پردازش ریاضی ]�2، و [ خطای پردازش ریاضی ]�3کانال های رنگی، به ترتیب، و مقدار میانگین کانال رنگ مربوط به هر منطقه محاسبه می شود. به همین ترتیب، ناحیه 3×3 R دیگر با نقطه مشخصه کلیدی به عنوان مرکز روی تصویر عمق انتخاب شده و میانگین مقدار عمق هر ناحیه به دست می آید. محاسبه بر اساس فرمول زیر انجام می شود:

جایی که [ خطای پردازش ریاضی ]�نشان دهنده سه کانال رنگی تصویر، با [ خطای پردازش ریاضی ]�=1، 2 و 3؛ [ خطای پردازش ریاضی ]ایکستعداد نقاط در منطقه R، با مجموع نه نقطه ویژگی است. [ خطای پردازش ریاضی ]جی�نشان دهنده مقدار میانگین منطقه R در [ خطای پردازش ریاضی ]�کانال رنگی تصویر؛ [ خطای پردازش ریاضی ]م�ایکسنشان دهنده ارزش [ خطای پردازش ریاضی ]�کانال رنگی [ خطای پردازش ریاضی ]ایکسنقطه مشخصه روی تصویر؛ [ خطای پردازش ریاضی ]اچنشان دهنده مقدار میانگین ناحیه R از تصویر عمق است. و [ خطای پردازش ریاضی ]نایکسنشان دهنده ارزش [ خطای پردازش ریاضی ]ایکسنقطه مشخصه در تصویر عمق.

پس از به دست آوردن مقدار میانگین [ خطای پردازش ریاضی ]جی�از هر کانال رنگ منطقه R در اطراف نقطه کلید رنگ [ خطای پردازش ریاضی ]منتصویر، کدگذاری باینری رنگ و عمق مربوط به نقطه کلیدی است [ خطای پردازش ریاضی ]منتولید می شود:

جایی که [ خطای پردازش ریاضی ]سی�ایکسنشان دهنده کدگذاری رنگی باینری است [ خطای پردازش ریاضی ]ایکسنقطه ویژگی در [ خطای پردازش ریاضی ]�کانال رنگی تصویر مقدار هر کانال رنگی هر نقطه مشخصه در همسایگی R بر روی نقطه کلیدی متمرکز شده است [ خطای پردازش ریاضی ]منبا مقدار میانگین کانال منطقه R مقایسه می شود. اگر مقدار نقطه کمتر از مقدار میانگین کانال منطقه باشد، کد باینری نقطه 0 است. اگر مقدار نقطه بزرگتر از مقدار میانگین کانال باشد. از منطقه، کد باینری نقطه 1 است. [ خطای پردازش ریاضی ]�ایکسرمزگذاری باینری را نشان می دهد [ خطای پردازش ریاضی ]ایکسنقطه مشخصه در تصویر عمق مربوطه. مقدار عمق هر نقطه مشخصه در همسایگی R بر روی نقطه کلیدی متمرکز است [ خطای پردازش ریاضی ]منبا مقدار میانگین عمق منطقه R مقایسه می شود. اگر مقدار نقطه کمتر از عمق متوسط منطقه باشد، کد باینری 0 است. اگر بزرگتر از میانگین باشد، کد باینری 1 است. هر کانال رنگی دارای 9 کد باینری، مجموعا سه کانال رنگی و یک کانال عمق است. به طور خاص، یک تصویر دارای 36 کد است.

پس از انجام عملیات فوق روی یک تصویر، کدگذاری باینری تصویر در سه کانال رنگی و کانال عمقی حریف به دست می آید. پس از به دست آوردن کدگذاری باینری رنگی همه مناطق اطراف نقاط کلیدی رنگ، به بردار نمایش اصلی VLAD اضافه می شود به طوری که یک بردار جدید با طول [ خطای پردازش ریاضی ]ک×(�+36)به دست می آید که بردار کدگذاری ویژگی بهبود یافته VLAD است. روند به دست آوردن کد ویژگی بهبود یافته VLAD در شکل 2 نشان داده شده است .

3.4. اندازه گیری تشابه

نتایج بازیابی تصویر بر اساس قوانین مورد استفاده برای سنجش شباهت بین تصاویر مرتب شدند. برای ارزیابی اینکه آیا دو تصویر مطابقت دارند، باید از معیار تشابه برای محاسبه شباهت بین تصاویر استفاده کنیم. معیار تشابه فاصله بین بردارهای توصیفگر نمونه را محاسبه می کند و پس از بدست آوردن توصیفگر کدگذاری ویژگی تصویر، آنها را مرتب می کند.

از آنجایی که بردار توصیفگر در این مطالعه باینری است، برای ارزیابی شباهت بیشتر، از فاصله همینگ [ 39 ] فاصله بین بردارهای اندازه گیری استفاده شده است. فاصله همینگ برای محاسبه شباهت دو بردار استفاده می شود. یعنی با مقایسه اینکه آیا هر بیت از بردار یکسان است یا خیر، اگر متفاوت باشد، فاصله همینگ با یک اضافه می شود تا فاصله همینگ به دست آید. هر چه شباهت بردار بیشتر باشد، فاصله همینگ مربوطه کمتر است:

جایی که [ خطای پردازش ریاضی ]د(ایکس،�)نشان دهنده فاصله همینگ دو بردار توصیف کننده است [ خطای پردازش ریاضی ]ایکس،�، که هستند [ خطای پردازش ریاضی ]ک×(�+36)کدهای بیت به علاوه، [ خطای پردازش ریاضی ]⊕عملیات XOR را نشان می دهد.

4. تخمین پوس

پس از بازیابی شبیه ترین تصویر، تفاوت مشخصی بین آن و حالت دستگاه دستی وجود دارد که در رابطه تبدیل بین پوزهای دو تصویر توضیح داده شده است. بنابراین، در این فرآیند، یک ماتریس چرخش [ خطای پردازش ریاضی ]آرو ماتریس ترجمه [ خطای پردازش ریاضی ]تیمورد نیاز هستند. از آنجایی که مدل سه بعدی صحنه توسط کتابخانه تصویر صحنه تولید شده است، مشابه ترین تصویر دارای ابر نقطه سه بعدی مربوط به خود است. هدف حل مسئله در اینجا حل ماتریس چرخش و ترجمه بین یک ابر نقطه سه بعدی و یک تصویر است. این مورد یک مشکل 2 بعدی-3 بعدی است که با PnP قابل حل است.

معادله همگن نقطه فضای بالا [ خطای پردازش ریاضی ]پاست [ خطای پردازش ریاضی ]پ=(ایکس،�،ز)تی. اجازه دهید آن را به نقطه ویژگی پروژه [ خطای پردازش ریاضی ]ایکس→1=(تو1،�1،1)تی. برطرف كردن [ خطای پردازش ریاضی ]آرو [ خطای پردازش ریاضی ]تی، ماتریس تقویت شده [ خطای پردازش ریاضی ][آر|تی]تعریف شده است؛ پس از بسط معادله، نتایج زیر را بدست می آوریم:

پس از حذف [ خطای پردازش ریاضی ]س، محدودیت بدست می آید:

اینجا، [ خطای پردازش ریاضی ]تییک متغیر است. یک نقطه ویژگی می تواند دو محدودیت را برای آن ایجاد کند [ خطای پردازش ریاضی ]تیاگر وجود دارد [ خطای پردازش ریاضی ]ننقاط ویژگی؛ معادله زیر برقرار است:

جایی که [ خطای پردازش ریاضی ]تیدارای 12 متغیر است و راه حل T را می توان حداقل با شش جفت نقطه تطبیق به دست آورد. از این رو، از این روش به عنوان روش تبدیل خطی مستقیم یاد می شود. هنگامی که نقاط تطبیق بیش از شش جفت هستند، روشهای تجزیه ارزش منفرد (SVD) [ 40 ] میتواند برای حل معادله بیش از حد تعیینشده استفاده شود.

محلول T از R و t تشکیل شده است، بنابراین R R = SO(3) را برآورده می کند. از این رو، ما باید بهترین ماتریس چرخش را برای ماتریس T پیدا کنیم که می تواند با تجزیه QR [ 41 ] تکمیل شود، که معادل شبح نتیجه از فضای ماتریس به منیفولد SE(3) است و آن را به چرخش و تبدیل می کند.

5. آزمایش کنید

در این بخش، محیطهای آزمایشی و مجموعه دادههای مورد استفاده را معرفی میکنیم، نتایج موقعیتیابی بصری روش پیشنهادی و همچنین روش اصلی VLAD را ارائه میکنیم و سپس آنها را با هم مقایسه میکنیم.

5.1. محیط های آزمایشی و مجموعه داده ها

الگوریتم ها بر روی رایانه ای با پردازنده مرکزی Intel i5 2.50 گیگاهرتز، 8 گیگابایت رم راه اندازی شدند. کامپیوتر سیستم عامل Ubuntu 16.04 LTS را نصب کرده است که یک سیستم عامل متن باز پرکاربرد است. کد به زبان C++ نوشته شده است.

برای تأیید اثربخشی الگوریتم پیشنهادی، آزمایشها بر روی تصاویر عمقی Intel RealSense D435i (سازنده: Intel Co., Ltd., Santa Clara, CA, USA) از چندین مجموعه داده عمومی انجام شد و با الگوریتمهای VLAD مقایسه شد [ 37 ] ]. مجموعه داده OpenLORIS-Scene [ 42] که توسط محققان مرکز تحقیقات اینتر و دانشگاه Tsinghua ایجاد شده است، دارای تصاویر RGB و عمقی است که توسط RealSense D435i با وضوح 848 × 480 و دادههای یک واحد اندازهگیری اینرسی، یک دوربین چشم ماهی و یک کیلومتر شمار چرخ جمعآوری شده است. داده های هر حسگر به طور همزمان جمع آوری شد. در این مطالعه از داده های تصویر RGB و عمق استفاده شد. تصویر عمق پردازش شد و با تصویر RGB تراز شد. ما حقایق اصلی را از طریق بازسازی مصنوعی، ارجاع به اطلاعات از تصاویر RGB ترکیب کردیم. از مجموعه داده های پنج صحنه استفاده شد: محیط خانه، کافه، دفتر و راهرو.

5.2. نتایج تجربی و مقایسه

در چهار صحنه خانه، کافه، دفتر و راهرو مجموعه داده LORIS، داده های تصاویر RGB-D با شدت نور متوسط برای ساخت مدل سه بعدی انتخاب شده است. مجموعه داده با روشنایی متوسط می تواند دشواری ساخت مدل و تخمین ژست را کاهش دهد و اثر بهتر و دقت بالاتری دارد. این برای استفاده بعدی از این وضعیت ها به عنوان پایه ای برای موقعیت بصری مفید است. مدل سه بعدی چهار صحنه در شکل 3 نشان داده شده است .

در مرحله بازیابی تصویر، این آزمایش دو تصویر را به عنوان تصاویر بازیابی در هر یک از چهار صحنه ذکر شده در بالا انتخاب می کند. هر تصویر توسط VLAD و روش پیشنهادی ما در مجموع هشت بار بازیابی شد. اولین تصویر مشابه به عنوان نتیجه نمایش داده می شود. تصاویری که باید بازیابی شوند و تصاویری که قبلاً در مجموعه آموزشی بازیابی تصویر ساخته شده بودند، در شرایط نوری مختلف گرفته می شوند. به این ترتیب می توانیم اثر بازیابی تصویر را در شرایط تغییر نور و تفاوت بین این دو روش به طور موثر مقایسه کنیم.

در صحنه خانه، دو عکس گرفته شده در هنگام روشن بودن چراغ ها در شب را به عنوان تصاویر مجموعه پرس و جو انتخاب کردیم. تصاویر مجموعه آموزشی زمانی گرفته می شوند که نور در روز روشن نیست. شرایط نوری مجموعه کوئری و مجموعه آموزشی متفاوت است. شکل 4مشابه ترین تصویر (یعنی تصویری با کمترین فاصله همینگ) را نشان می دهد که هر بار پس از بازیابی دو تصویر با روش VLAD و روش پیشنهادی ما بازیابی می شود. برای اولین تصویر مجموعه پرس و جو، روش VLAD کمد لباس را جستجو می کند. هنوز بین عکس های مورد نظر و کمد فاصله وجود دارد که فقط قسمت کوچکی را به خود اختصاص می دهد. نتیجه روش پیشنهادی ما به تصویر پرس و جو بسیار نزدیک است. تصویر دوم مجموعه پرس و جو در مقابل کمد لباس گرفته شده است. نتایج بازیابی این دو روش عمدتاً تصاویری از کمد لباس است. تصاویر بازیابی شده با روش پیشنهادی ما به تصاویر بازیابی شده نزدیکتر هستند.

از آنجایی که شرایط نوری هر مجموعه داده از صحنه کافه تقریباً یکسان است، شرایط نور مجموعه کوئری و مجموعه آموزشی مشابه است. شکل 5 مشابه ترین تصاویری را که هر بار پس از بازیابی دو تصویر با روش VLAD و روش پیشنهادی ما بازیابی می شود، نشان می دهد. اولین تصویر از مجموعه پرس و جو در مقابل نوار نزدیک صندلی گرفته شده است. تصویر بازیابی شده با روش VLAD در پشت نوار گرفته شده است که کمی با تصویر مورد نظر متفاوت است. تصویر بازیابی شده با روش پیشنهادی ما در جلوی نوار قرار دارد که مشابه تصویر در حال بازیابی است. برای تصویر دوم، نتایج بازیابی دو روش مشابه تصویر بازیابی شده است و نتایج این روش مشابه است.

در صحنه اداری، دو عکس گرفته شده در فضای باریک با نور ضعیف به عنوان تصاویر مجموعه پرس و جو انتخاب می شوند. وضعیت روشنایی تصویر مجموعه تمرینی متوسط است. شکل 6 نتایج بازیابی دو روش را نشان می دهد. برای اولین تصویر در مجموعه پرس و جو، فاصله بین نتیجه بازیابی توسط VLAD و تصویر پرس و جو بسیار زیاد است و این دو تصویر هیچ نقطه ویژگی مشترکی ندارند، بنابراین استفاده از PnP برای حل ژست غیرممکن است. نتایج بازیابی با روش پیشنهادی ما بسیار نزدیک به تصاویر بازیابی شده است. برای تصویر دوم مجموعه پرس و جو، تصاویر بازیابی شده توسط دو روش مشابه تصویر پرس و جو هستند.

در صحنه راهرو، دو عکس گرفته شده در شرایط نور شدید خورشید به عنوان تصاویر مجموعه پرس و جو انتخاب می شوند. وضعیت روشنایی تصویر مجموعه تمرینی متوسط است. شکل 7 نتایج بازیابی دو روش را نشان می دهد. به طور کلی، تصاویر بازیابی شده مشابه تصاویر بازیابی شده است. با این حال، نتیجه بازیابی تصویر دوم در مجموعه پرس و جو کاملاً با آن متفاوت است.

پس از اتمام بازیابی تصویر، تصاویری را انتخاب می کنیم که در هر نتیجه پرس و جو صحنه رتبه اول را دارند تا پوز را تخمین بزنیم. در مرحله اولیه، ما مدل سه بعدی صحنه ها را تولید کرده ایم. ابر نقطه سه بعدی مربوط به نتیجه پرس و جو را استخراج می کنیم. ابر نقطه و تصویر نتیجه بازیابی با استفاده از روش PnP برای محاسبه ژست 3D-2D استفاده می شود. از آنجایی که تصاویر در مجموعه های قطار دارای حالت 6-DOF هستند، موقعیت 6-DOF تصویر پرس و جو را می توان با محاسبه ماتریس جابجایی و ماتریس چرخش بین تصویر پرس و جو و نتیجه پرس و جو شناخته شد.میز 1مختصات سه بعدی هر تصویر پرس و جو در چهار صحنه خانه، کافه، اداره و راهرو توسط VLAD و روش پیشنهادی ما و همچنین خطای مقایسه با مقدار واقعی زمین را نشان می دهد. مشاهده می شود که خطاهای مختصات روش VLAD نسبتاً زیاد است. برخی از آنها خطاهای 5-6 متر دارند. علاوه بر این، چون نتیجه پرس و جوی تصویر پنجم دارای نقاط مشخصه یکسانی با تصویر درخواست شده نیست، پوز آن قابل محاسبه نیست. خطاهای روش پیشنهادی ما نسبتاً کوچک است و حداکثر خطا حدود دو متر است. در مقایسه با روش اصلی VLAD، بسیار بهبود یافته است.

جدول 2 زاویه هر تصویر پرس و جو را در چهار صحنه محاسبه شده با VLAD و روش پیشنهادی (بیان شده توسط کواترنیون برای راحتی محاسبه)، همراه با خطاها در مقایسه با مقدار واقعی زمین نشان می دهد. اگرچه خطاهای دو روش کم است، اما نتایج روش VLAD نسبتاً زیاد است. در مقایسه با روش اصلی VLAD، خطای روش پیشنهادی نسبتاً کم است.

ORB-SLAM2 یکی دیگر از روش های پیشرفته موقعیت یابی است که توسط Mur-Artal و Tardós [ 43 ] پیشنهاد شده است. از توصیفگر و استخراج کننده ویژگی برای ردیابی برای مکان یابی و نقشه برداری بلادرنگ استفاده می کند. از داده های دوربین تک چشمی، استریو و RGB-D پشتیبانی می کند. جدول 3 و جدول 4 نتیجه تخمین موقعیت و زاویه روش ORB-SLAM2 را نشان می دهد. بیشتر خطاها بزرگتر از خطاهای روش پیشنهادی ما هستند. این نشان می دهد که اثر موقعیت یابی روش پیشنهادی ما بهتر است.

جدول 5 میانگین خطا و میانگین زمان موقعیت یابی سه روش را نشان می دهد. از آنجایی که روش پیشنهادی ظرفیت توصیفگر VLAD را افزایش می دهد، کمی بیشتر از VLAD اصلی زمان می برد، اما هنوز در سطح بسیار کارآمدی است. ORB-SLAM2 سریعتر از VLAD است. در مقایسه با روش اصلی VLAD و ORB-SLAM2، روش پیشنهادی دقت موقعیت یابی را تا حد زیادی بهبود می بخشد زمانی که شرایط روشنایی مجموعه پرس و جو و مجموعه آموزشی متفاوت است.

6. نتیجه گیری و بحث

در این مقاله، ما یک روش موقعیتیابی بصری با استفاده از تصویر RGB-D در دستگاههای تلفن همراه هوشمند پیشنهاد کردیم. در این مقاله، ما روش بازیابی تصویر VLAD را که برای موقعیتیابی دید موبایل اعمال میشود، بهبود میبخشیم. این روش از مزایای مصرف حافظه کم، سرعت محاسبات سریع و دقت بالا برخوردار است. در مرحله اول، ژست هر تصویر در مجموعه آموزشی از طریق استخراج و شرح ویژگی ORB، ثبت تصویر و بهینه سازی نقشه ژست محاسبه می شود. سپس، در مرحله بازیابی تصویر، مجموعه آموزشی و مجموعه پرس و جو برای تولید بردار توصیف VLAD خوشه بندی می شوند. به منظور غلبه بر این مشکل که بردار توضیحات اطلاعات رنگ تصویر را از دست می دهد و دقت بازیابی را در شرایط نوری مختلف بهبود می بخشد. ما اطلاعات رنگ و اطلاعات عمق را با توصیفگرهای VLAD برای بازیابی تصویر ترکیب کردیم. هنگامی که شرایط روشنایی و شرایط رنگ تغییر می کند، قوی است. فضای رنگی مخالف، همراه با اطلاعات عمق، می تواند استحکام بازیابی تصویر را در شرایط نوری مختلف افزایش دهد. در نهایت، حالت 6-DOF تصاویر پرس و جو با روش PnP با تصویر پرس و جو محاسبه شده و تصویر نتیجه بازیابی می شود. آزمایشها بر روی دادههای RGB-D چهار صحنه (کافه، راهرو، خانه و دفتر) در مجموعه داده LORIS انجام شده است. نتایج تحت شرایط مختلف روشنایی در صحنههای داخلی نشان میدهد که روش پیشنهادی دقت موقعیتیابی را در مقایسه با VLAD و ORB-SLAM2 اصلی که کارایی محاسباتی خوبی دارد، بهبود میبخشد. از سوی دیگر، آزمایش دیگری توسط ما نشان میدهد که هنگام استفاده از اطلاعات عمق بدون جزء رنگ، خطاهای تخمین موقعیت 8 تصویر پرس و جو 0.300، 0.552، 2.457، 0.417، 3.076، 0.497، 0.928، و 3.764 است. خطاها بزرگتر از خطاهای دارای جزء رنگ هستند.

با توجه به زمان و انرژی محدود نویسنده، ارائه یک فناوری کامل در موقعیت یابی داخلی غیرممکن است. بنابراین، هنوز برخی از مطالب پژوهشی در این زمینه وجود دارد که نیاز به بهبود و تکمیل دارند. در حال حاضر، کارایی روش پیشنهادی نیاز به بهبود دارد. در تحقیق بعدی سعی خواهیم کرد از خوشه بندی سلسله مراتبی به جای خوشه بندی k-means موجود برای بهبود کارایی استفاده کنیم. به منظور بهبود دقت، ممکن است با استفاده از روش یادگیری عمیق تحقیقاتی انجام دهیم. از سوی دیگر، برای جلوگیری از اتلاف وقت در فرآیند انتقال شبکه، باید روشی را نیز مطالعه کنیم که کمتر به سرور وابسته باشد.

ممکن است در تصویر درخواستی که توسط کاربران دستگاه تلفن همراه گرفته شده، انسداد وجود داشته باشد. آنها دشواری بازیابی تصویر را تا حدی افزایش می دهند و همچنین بر دقت الگوریتم تخمین موقعیت تأثیر می گذارند. بنابراین، در کار آینده، الگوریتم فیلتر ویژگی بصری را در مورد انسداد مطالعه خواهیم کرد و سعی خواهیم کرد تا دقت موقعیت یابی را از طریق الگوریتم فیلتر ویژگی بصری بهبود بخشیم.

بدون دیدگاه